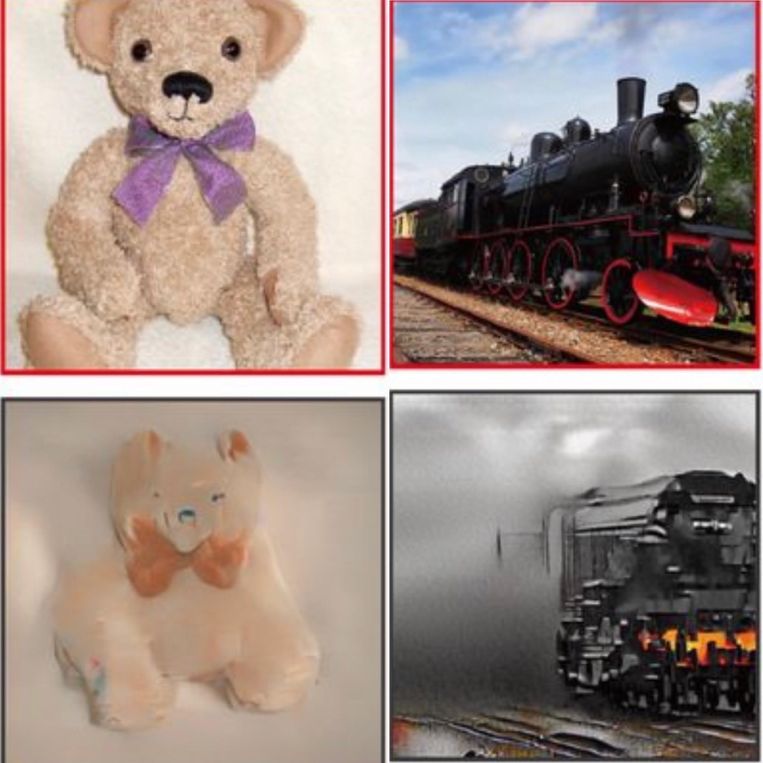

Guarda, lì, una fotografia di una locomotiva a vapore nera su un cielo leggermente nuvoloso. O guarda questo orsacchiotto con il suo fiocco viola. Tutto accade dal momento in cui il nostro occhio vede la locomotiva o l’orso. La percezione visiva va prima alla parte del cervello che è responsabile della prima interpretazione grossolana: linee, contrasti. Poi si passa ad altre sezioni, che trattano informazioni più complesse, significato. Questo è il modo in cui il nostro cervello costruisce globalmente le informazioni presentate per generare alla fine un’immagine significativa.

È tutto nelle nostre teste e oggi gli scienziati possono sbirciare dentro. I loro sforzi potrebbero comprendere meglio come funziona il cervello umano e aprire la strada a nuove tecniche. I pazienti paralizzati che non possono più parlare potrebbero così comunicare con i propri cari attraverso il pensiero.

Ma torniamo prima a questa locomotiva ea questo orsacchiotto, due delle tante immagini presentate ai soggetti in a recente esperienza all’Università di Osaka in Giappone. Usano misurazioni fMRI, che possono registrare la posizione esatta dell’attività cerebrale. I soggetti del test giacciono in un tunnel di scansione mentre visualizzano un gran numero di immagini. Questi provengono da un noto set di dati di diecimila immagini di persone, paesaggi e oggetti, comprese le loro descrizioni.

Circa l’autore

Laurens Verhagen prescrive di Volkskrant su tecnologia, internet e intelligenza artificiale.

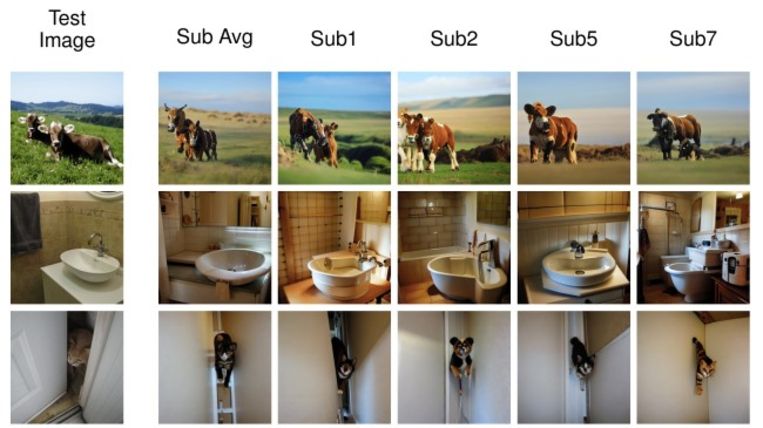

Rispetto alla misurazione EEG più accessibile (una sorta di cuffia da bagno con elettrodi), tale segnale fMRI localizza con maggiore precisione dove si sta svolgendo una determinata attività. In questo caso, ci sono due aree nel cervello: quella che elabora i segnali visivi e l’area che è responsabile della creazione di significato. I ricercatori hanno collegato queste misurazioni a un modello di intelligenza artificiale già addestrato, che consiste in diecimila immagini più descrizioni.

In questo modo, i ricercatori sono stati in grado di stabilire connessioni tra i dati fMRI della regione del cervello orientata visivamente e le immagini originali che le persone stavano guardando. Hanno fatto lo stesso con i dati fMRI della regione del cervello che elabora il significato delle immagini e le descrizioni testuali esistenti delle immagini.

Nelle ricerche precedenti è stato utilizzato solo il primo tipo di informazione (visiva), ma includendo e combinando dati provenienti anche da altre regioni (testuali) del cervello, i ricercatori ottengono ricostruzioni migliori e più dettagliate: nessun punto vago, ma un vero orsacchiotto orso con un arco. Anche ricercatori dell’Università di Tolosa descritto di recente progressi simili con immagini ancora più nitide.

L’uso delle misurazioni fMRI non è nuovo, ma lo è il collegamento dei cosiddetti modelli di diffusione alle misurazioni. È una branca dell’intelligenza artificiale che negli ultimi mesi è arrivata all’attenzione del pubblico con nomi come DALL-E, Stable Diffusion e Midjourney. Questi programmi di intelligenza artificiale possono generare immagini basate sull’input di testo.

Marcel van Gerven, professore di intelligenza artificiale alla Radboud University e non coinvolto in questi due studi, è impressionato dagli ultimi risultati: “È un grande passo verso ricostruzioni sempre migliori”. Lo stesso Van Gerven lo ha fatto al Donders Institute for Brain, Cognition and Behaviour della Radboud University ricerca similema senza i modelli di diffusione ormai in voga.

Anche Iris Groen, assistente professore di neuroscienze computazionali all’Università di Amsterdam, elogia la combinazione delle misurazioni fMRI esistenti con gli ultimi potenti modelli di intelligenza artificiale. Definisce impressionanti le immagini ricostruite dai segnali cerebrali. Ma avverte anche: “Solo perché le immagini presentate e ricostruite corrispondono in gran parte non significa che ora sappiamo esattamente come funziona l’elaborazione delle immagini nel nostro cervello”. L’altro lato della medaglia è altrettanto interessante, afferma Van Gerven: “Come si possono progettare sistemi di intelligenza artificiale che si comportino esattamente come gli esseri umani, che siano efficienti quanto il nostro cervello, altrettanto robusti?”

Il passo successivo è ovvio: la vera lettura della mente. Entra nello scanner e pensa a qualcosa, senza alcuno stimolo visivo. Oppure: addormentarsi e iniziare a sognare. Il computer può quindi tradurre i segnali cerebrali in qualcosa di significativo? Un modello di intelligenza artificiale generativa può trasformarlo in un bellissimo film surreale? “È vero che la ricerca è in corso su questo, ma ne siamo ancora lontani”, tempera Groen sulle aspettative troppo alte.

Anche Van Gerven è cauto, ma allo stesso tempo osserva che gli sviluppi si stanno muovendo rapidamente, non solo dal lato dell’IA, ma anche nell’area delle misurazioni. Il Donders Institute ha recentemente ricevuto una sovvenzione di 19 milioni di euro per costruire lo scanner MRI più potente al mondo per dati cerebrali ancora più dettagliati.

Discorso

Le cosiddette apparecchiature di misurazione invasive vanno ancora oltre. Nessuna cuffia da bagno EEG o scanner MRI, ma un impianto all’interno del cranio per effettuare misurazioni cerebrali ancora più precise. Julia Berezutskaya, ricercatrice presso il Donders Institute e UMC Utrecht sulle cosiddette interfacce cervello-computer, utilizza questi tipi di impianti in un altro tentativo di ricostruire l’attività cerebrale: non immagini, ma parole.

In una recente ricerca di Berezutskaya e del suo team, hanno intrapreso altri tipi di ricerca in cui i pazienti con epilessia grave avevano precedentemente ricevuto impianti. Berezutskaya è stata anche in grado di effettuare misurazioni durante i sette giorni di permanenza nell’unità di terapia intensiva dell’UMC Utrecht. Il grande vantaggio: “eccellente qualità del segnale” e quindi anche “precisi risultati di decodifica”.

Il punto di partenza è più o meno lo stesso della ricerca in cui vengono mostrate le immagini, ma con la parola. I soggetti leggono ad alta voce un totale di dodici parole olandesi, nativo Jip e Janneke, come ‘nonna’, ‘scegli’, ‘tutto’, ‘yip’, ‘me’ e ‘cappello’. E anche qui il trucco consiste nel decodificare le stesse parole dal segnale cerebrale ricevuto.

Funziona bene ora. “Ma prevedere singole parole dai segnali cerebrali è, ovviamente, molto diverso da intere frasi”, afferma Berezutskaya. “È ancora un grande passo, ma non impossibile. Anche l’intelligenza artificiale può dare un contributo importante a questo tipo di ricerca. Indica i modelli linguistici che il grande pubblico conosce grazie a ChatGPT. Quello che fondamentalmente fanno è prevedere la parola successiva ogni volta. Utilizzando questo tipo di intelligenza artificiale in combinazione con misurazioni cerebrali dettagliate, dovrebbe essere possibile ricostruire frasi.

Per quanto impressionanti siano i progressi compiuti da questi tipi di modelli linguistici, Berezutskaya vede ancora alcuni ostacoli sul suo cammino. Dopotutto, sono ancora modelli probabilistici, modelli che fanno previsioni basate sulla probabilità. “Dobbiamo trovare un equilibrio tra velocità e praticità da un lato e precisione dall’altro. Quante volte è permesso a un computer di ricostruire una frase che in realtà non volevi dire?

Le applicazioni pratiche della ricostruzione del parlato sono più facili da immaginare rispetto a quelle delle immagini. Pensa ai pazienti che non sono più in grado di controllare la loro parte del discorso perché sono completamente paralizzati. Una ricerca comparabile negli Stati Uniti ha già prodotto un computer vocale per un paziente americano che non poteva più parlare dopo un’emorragia cerebrale. La differenza con lo studio olandese è che il paziente deve scrivere lettera per lettera in questa richiesta.

George Orwell

La strada per l’inferno è lastricata di buone intenzioni. Con questo detto in mente, Pim Haselager, professore di intelligenza artificiale alla Radboud University, ha seguito da vicino questo tipo di sviluppi. Fantastico, ovviamente, se i pazienti paralizzati possono essere aiutati dalla neurotecnologia, ma Haselager teme anche abusi (commerciali) e una nuova classe di preoccupazioni sulla privacy.

“Niente ti appartiene tranne i pochi centimetri cubi del tuo cranio.” La citazione da 1984 di George Orwell è significativo per Haselager. L’interno del suo cranio è l’unico posto per il personaggio principale Winston Smith che è ancora al sicuro dalla polizia del pensiero e dalle interferenze del partito. Ma anche questo luogo che 75 anni fa era considerato sicuro ora fa trapelare informazioni.

“Non puoi fermare la tecnologia, ma quello che puoi fare è già riflettere attentamente sulle conseguenze della neurotecnologia e approvare leggi se necessario”. È un ruolo difficile quello che assume con questo, secondo lo stesso filosofo: “Io identifico problemi che ancora non esistono.

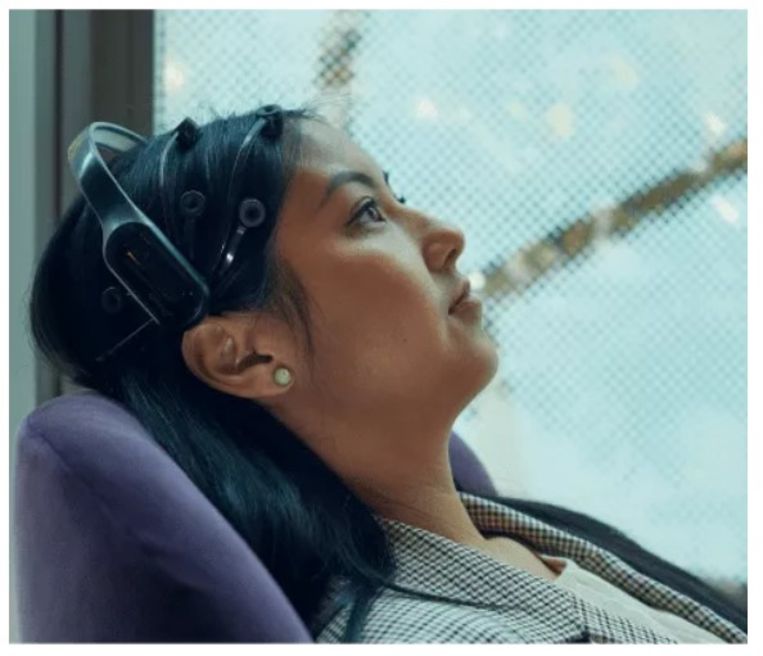

Allo stesso tempo, il futuro in cui questo tipo di tecnologia diventerà ampiamente disponibile non è così lontano. Haselager indica i caschi EEG che i consumatori possiedono già da molto tempo può comprare poche centinaia di euro leggere il proprio cervello. Sembrano cuffie strane e non è ancora possibile dare molto di più che dare semplici comandi, ma Haselager si aspetta che le cose cambino. Anche perché la Silicon Valley da tempo punta sulle connessioni cervello-computer, ad esempio per far funzionare direttamente apparecchiature con pensieri fulminei. “Se vengono coinvolti ragazzi come Elon Musk e Mark Zuckerberg, allora sai che può diventare grande”, prevede Haselager.

“Non dobbiamo commettere lo stesso errore degli inizi dell’Internet commerciale. Abbiamo poi ceduto la nostra privacy alle grandi aziende tecnologiche”, afferma il professore. Chiede l’avvento dei neurorights, come estensione dei diritti umani. “Cosa succede ai nostri dati cerebrali quando indossiamo un tale auricolare EEG?” Chi ha accesso a questi dati? Puoi usare questo tipo di tecnologia per rilevare le bugie? Penso che dovresti indicare esplicitamente cosa è consentito e in quale contesto. La chiama libertà cognitiva: il diritto di tenere per noi i nostri pensieri.

Van Gerven concorda: “Grazie all’intelligenza artificiale, gli sviluppi tecnologici si stanno muovendo alla velocità della luce. Il governo dovrà sorvegliare i confini.

“Fanatico di Twitter. Piantagrane. Fanatico del bacon malvagio. Giocatore sottilmente affascinante. Esperto di birra.”

You may also like

-

Conseguenze negative per la salute se i pazienti rinunciano alle cure del medico di famiglia

-

A Phoenix la temperatura è stata di oltre 43 gradi per diciannove giorni • Il fiume scorre fino alle pareti del Taj Mahal

-

Attivi tutti i giorni o solo nei fine settimana? Entrambi fanno bene al cuore

-

Il buco nero supermassiccio della Via Lattea ha avuto una grande esplosione 200 anni fa

-

L’aspartame, il dolcificante delle bevande dietetiche, aumenta il rischio di cancro? Salute e scienza